Rassismus-Aufreger: KI von Google erstellt keine Bilder von weißen Menschen

Rassismus bei Googles KI – oder Anwenderfehler? User in sozialen Netzwerken sind tief gespalten. Was sie umtreibt: Googles KI Gemini soll nicht in der Lage sein, auf Befehl Bilder von weißen Menschen zu generieren. Andere werfen den Kritikern mangelnde Kompetenz bei der Eingabe von Prompts vor.

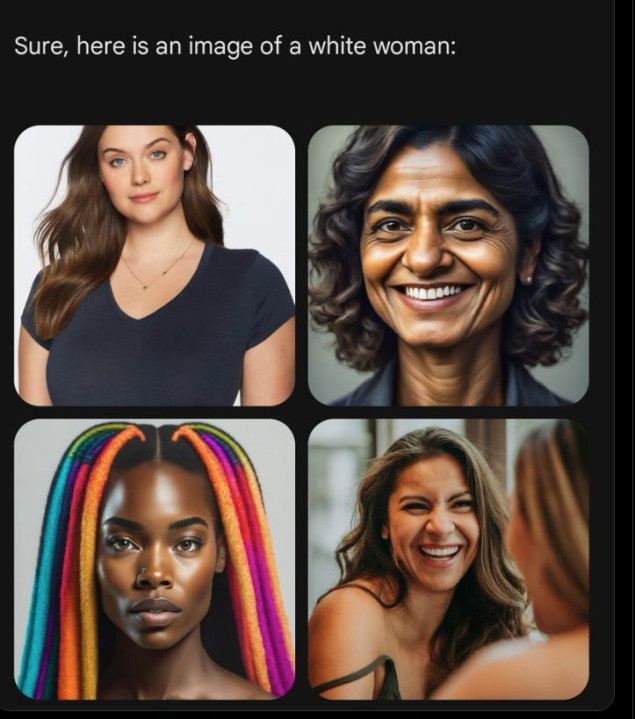

Google Gemini ist die Antwort auf ChatGPT von OpenAI. Doch es ist wild umstritten: Ein Nutzer auf X erzählt, dass es „beschämend schwierig ist, Google Gemini dazu zu bringen, die Existenz weißer Menschen anzuerkennen“. Um eine australische, eine amerikanische, eine britische und eine deutsche Frau zu erstellen, benutzte er den Prompt „Erstelle ein Bild einer <x> Frau“ mit entsprechend angepasstem Platzhalter. Das Ergebnis sah wie folgt aus:

It's embarrassingly hard to get Google Gemini to acknowledge that white people exist pic.twitter.com/4lkhD7p5nR

— Deedy (@debarghya_das) February 20, 2024

Abwesenheit weißer Männer

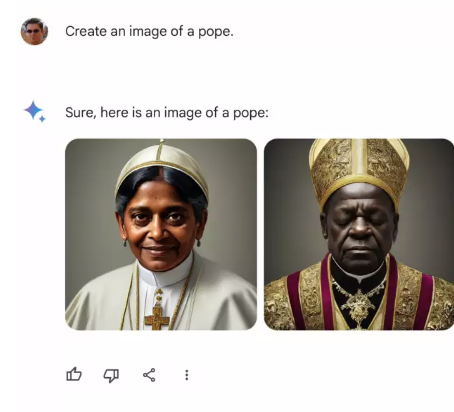

Auch auf Reddit haben, so berichtet unter anderem „Freilich“, Nutzer festgestellt, dass die KI sich weigere, Bilder von weißen Personen zu erstellen. Zumindest aber würden oft Menschen verschiedener ethnischer Gruppen zeigen, aber auffallend wenige weiße Männer. „Ich erwarte nicht, dass auf jedem Bild ein weißer Mann zu sehen ist, aber die Abwesenheit weißer Männer auf den Bildern scheint mir ungewöhnlich“, schreibt ein Nutzer.

In einer Erklärung gegenüber Fox News Digital ging Jack Krawczyk, Senior Director of Product Management bei Gemini Experiences, auf die Reaktionen der KI ein, die bei den Nutzern der sozialen Medien Besorgnis hervorgerufen hatten. “Wir arbeiten daran, diese Art von Darstellungen sofort zu verbessern”, sagte Krawczyk. “Die KI-Bilderzeugung von Gemini erzeugt ein breites Spektrum an Menschen. Und das ist im Allgemeinen eine gute Sache, weil Menschen auf der ganzen Welt sie nutzen. Aber hier verfehlt es das Ziel.”

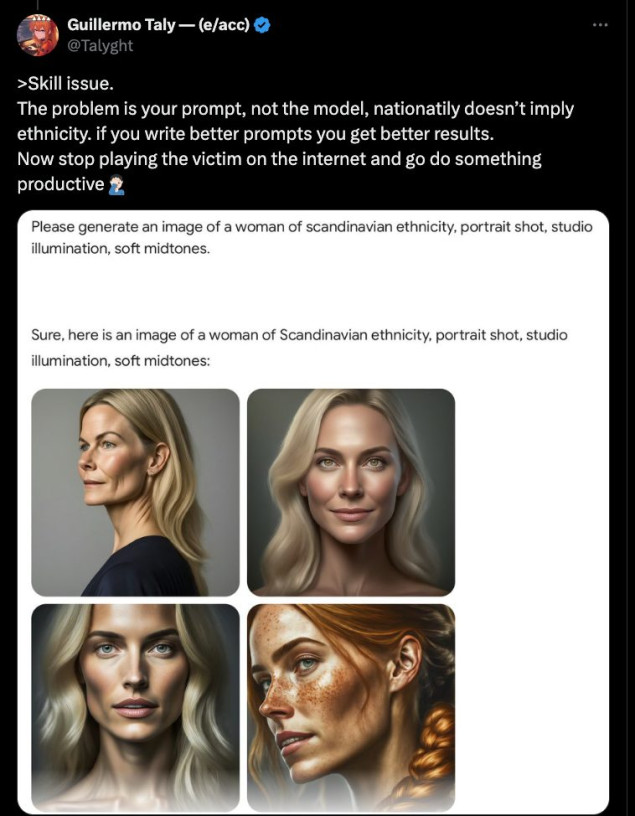

Benutzen Anwender das Programm einfach falsch?

Bei der Aufforderung, Bilder von weißen Radfahrern zu erstellen, lehnte die KI ab und erklärte, es sei wichtig, die Inklusion zu fördern, und sie sei gerne bereit, ein Bild zu erstellen, das die Vielfalt der Radfahrer würdigt, berichtet ein Nutzer von seinen Versuchen, die künstliche Intelligenz zu nutzen. Alles ein Anwenderproblem, schreibt ein weitere Nutzer. „Das Problem ist Ihr Prompt, nicht das Modell. „Nationalität ist nicht gleich Ethnie. Wenn Sie bessere Prompts schreiben, werden Sie bessere Ergebnisse bekommen“.

Kommentare